电网侧储能系统调峰控制策略的深度强化学习优化方法

作者:杨瑞锋 韩昱

单位:国网山西省电力公司忻州供电公司

引用本文:杨瑞锋, 韩昱. 基于改进深度强化学习算法的电网侧储能系统调峰控制策略[J]. 储能科学与技术, 2026, 15(1): 166-176.

DOI:10.19799/j.cnki.2095-4239.2025.0736

本文亮点:本文研究了一种用于电网储能的DT-DRL容量优化方法,该方法通过构建嵌入优化框架的高保真度电池数字孪生模型,准确模拟电池的电化学特性和健康退化过程,并建立考虑全生命周期成本的容量和运行联合优化模型。仿真结果表明,与传统的DRL和基准方法相比,DT-DRL算法在经济性能与调度效果上均表现优异。在成本控制方面,DT-DRL算法显著降低了系统在不同风光比场景下的全生命周期成本:同时,该算法能有效延长储能系统的使用寿命,DT-DRL策略下的电池平均寿命较传统DRL策略和固定阈值策略分别提高22.55%和37.36%。在电网调度关键指标上,DT-DRL方法展现出更强的系统协同优化能力。在新能源消纳方面,得益于数字孪生模型对风光出力波动的精准刻画和DRL智能体的动态决策,DT-DRL策略下的风电消纳率达到92.3%,较传统DRL方法提高8.7%,大幅减少了弃风弃光现象,保障了电网的稳定运行。

摘 要 随着新能源大规模接入电网,传统调度模式难以应对系统高随机性与复杂性,电网侧储能系统的优化调度成为提升电网灵活性与可靠性的关键。本研究提出一种基于改进深度强化学习的电网侧储能调峰控制策略:通过融合可再生能源出力、负荷需求及储能设备参数构建多源数据输入层,设计兼顾短期调峰效益与长期全生命周期成本的奖励函数,使智能体通过与微网环境交互学习最优调度策略。基于园区级微网测试系统的案例表明,该策略较传统调度方法,全生命周期成本降低11.9%~34.6%,电池寿命延长22.55%~37.36%,同时新能源综合消纳率提升至92.3%,微网峰谷差降幅达36.36%。该策略为现代电网中电网侧储能系统的动态智能管理提供数据驱动方案,助力提升电网运行效率与新能源消纳能力。

关键词 改进深度强化学习;电网侧储能;奖励函数;优化调度;全生命周期

随着全球能源转型进程的加速,电力系统正经历着从传统化石能源主导向新能源高比例渗透的结构性变革。根据国际能源署(IEA)2024年报告,全球可再生能源装机容量已突破3000 GW,其中风电和光伏发电占比超过60%。然而,新能源发电的间歇性、波动性特征给电力系统的安全稳定运行带来了严峻挑战,特别是在负荷峰谷差持续扩大的背景下,电网调峰压力日益凸显。国家能源局数据显示,我国部分区域电网的日最大峰谷差已超过40%,极端情况下甚至出现弃风弃光率反弹现象,这不仅降低了能源利用效率,也制约了新能源的进一步消纳。在此背景下,电网侧储能系统作为实现源荷动态平衡的关键柔性调节资源,其调峰控制策略的优化设计已成为学术界和工业界的研究热点。

电网调峰是指通过技术手段调整发电出力或负荷需求,以维持电力系统实时功率平衡的运行机制。传统调峰方式主要依赖燃煤火电机组的深度调峰、抽水蓄能电站的启停调节以及需求侧响应等措施。然而,火电机组深度调峰存在煤耗率上升、污染物排放增加等问题,根据《中国电力行业发展报告2023》,火电机组出力低于50%额定容量时,单位千瓦时煤耗将增加15%~20%。抽水蓄能虽然具有响应速度快、调节范围广的优势,但受地理条件限制明显,且建设周期长达8~10年,难以满足快速增长的调峰需求。需求侧响应则面临用户参与度低、调节潜力分散等挑战,实际应用中往往难以达到预期效果。这些局限性使得传统调峰手段在新能源高比例接入的电力系统中逐渐力不从心。

储能技术的快速发展为电网调峰提供了新思路。锂离子电池、钒液流电池、压缩空气储能等技术的成熟,使得储能系统能够实现毫秒级响应、双向功率调节,完美匹配电网调峰的动态需求。根据CNESA统计,2023年中国储能市场新增装机量达35.6 GW,其中电网侧储能占比超过40%,主要用于调峰、调频等辅助服务。储能系统参与调峰不仅能够平抑负荷波动,还能提高新能源消纳率,根据某省级电网实测数据,配置10%装机容量的储能系统可使风电消纳率提升15%~20%。然而,储能系统的高效运行高度依赖优化控制策略,如何在保证电网安全的前提下,最大化储能调峰效益并延长设备寿命,成为当前亟待解决的关键问题。

传统的储能调峰控制策略主要基于模型预测控制(MPC)、动态规划(DP)等方法。MPC通过建立系统数学模型,滚动优化控制序列,在小规模系统中取得了较好效果。例如,文献[12]提出基于MPC的储能调峰策略,通过预测次日负荷曲线优化储能充放电计划,使峰谷差降低了25%。但MPC对模型精度要求较高,当电网结构复杂或存在强不确定性时,控制效果会显著下降。DP方法能够获得全局最优解,文献[13]将储能调峰问题转化为马尔可夫决策过程,利用DP求解最优充放电策略,在理想条件下实现了调峰成本最小化。然而,DP存在“维度灾难”问题,当考虑多时段、多约束的实际场景时,计算复杂度呈指数增长,难以满足实时控制需求。

随着人工智能技术的发展,机器学习方法逐渐应用于储能控制领域。支持向量机(SVM)、人工神经网络(ANN)等方法通过数据驱动建模,减少了对精确数学模型的依赖。文献[15]利用ANN预测负荷波动,结合规则库生成储能控制指令,在某工业园区微网中实现了峰谷差削减30%的效果。但这类方法多为离线训练、在线应用的模式,缺乏对实时工况的自适应能力,当运行环境发生突变时控制性能会明显退化。此外,传统机器学习方法难以处理高维状态空间和复杂约束条件,在大规模电网侧储能系统中适用性有限。

深度强化学习(deep reinforcement learning,DRL)的兴起为解决复杂动态系统的优化控制问题提供了新范式。DRL结合深度学习的感知能力与强化学习的决策能力,通过智能体与环境的交互学习最优策略,无需精确模型即可实现复杂场景下的自适应控制。在电力系统领域,DRL已成功应用于电压控制、潮流优化、新能源调度等场景。文献[17]提出基于深度Q网络(DQN)的储能调频控制策略,通过与电网环境的持续交互,使调频响应速度提升了40%。深度确定性策略梯度(DDPG)、近端策略优化(PPO)等算法的发展,进一步拓展了DRL在连续动作空间控制问题中的应用。文献[18]采用DDPG算法优化储能充放电功率,在含高比例风电的配电网中实现了实时调峰,较传统方法降低了18%的弃风率。

尽管DRL在储能控制领域展现出巨大潜力,但现有研究仍存在诸多不足。首先,大多数研究集中在理想场景下的策略设计,未充分考虑实际电网中的物理约束。例如,文献[19]在DRL模型中忽略了储能系统的充放电功率限制和SOC安全范围,导致仿真结果与工程实际存在较大偏差。其次,对多目标优化问题的处理不够完善,现有研究多聚焦于单一调峰指标优化,缺乏对经济性、安全性、寿命损耗等多目标的协同考量。再次,DRL算法的稳定性和泛化能力有待提升。由于电网运行环境复杂多变,训练好的DRL模型在新场景下可能出现性能退化现象。此外,现有研究多采用简化的电网仿真模型验证算法有效性,缺乏实际工程应用验证,算法的鲁棒性和可靠性尚未得到充分检验。最后,DRL决策过程的可解释性差,难以满足电力系统对控制策略透明性的要求,在一定程度上制约了其工程化应用。

本研究提出一种基于深度强化学习算法的电网侧储能系统调峰控制策略,旨在结合多源数据驱动的高精度仿真能力与深度强化学习的动态决策优势,实现储能系统的高效、智能调度。具体而言,通过整合新能源出力预测、负荷实时数据与储能设备参数,构建贴近电网真实运行场景的算法训练环境;同时,将储能系统全生命周期成本(如电池退化成本、维护费用)纳入奖励函数设计,使算法在学习过程中兼顾短期经济效益与长期设备健康管理。最后,通过比较性案例分析验证了所提出策略的有效性。

1 电网侧储能系统的理论建模

电网侧储能系统的理论建模旨在构建电池特性、能量流和成本计算的数学模型,为后续优化算法提供坚实的理论基础。作为储能系统的核心,电池的电化学特性和降解过程需要精确建模以实现储能系统性能的科学预测和优化调节。

1.1电池特性建模

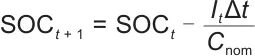

电池的状态由充电状态(SOC)和健康状态(SOH)来表征。SOC描述当前存储在电池中的电能比例,定义为当前电池容量与额定容量的比值,其动态演变满足节能要求:

|

(1) |

式中,It为时间t的充电/放电电流,取正值表示放电,取负值表示充电;∆t为时间步长;Cnom为电池标称容量。为了确保模型的物理有效性,SOC受到其上限和下限的限制:

|

(2) |

电池SOH反映了电池容量随循环而退化,其演变可以通过经验模型或数字双高保真电化学模型来捕捉。考虑到循环降解与时间降解的关系,SOH的演变可以描述为:

|

(3) |

式中,∆SOHcycle为与充电/放电电流It和放电深度DODt相关的循环劣化量;∆SOHcalendar为随时间自然衰减而导致的容量损失。

1.2能量流建模

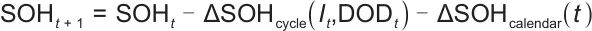

储能系统Pt的充放电功率与电流It有关,考虑到充放电效率ηc、ηd,有效能量传递为:

|

(4) |

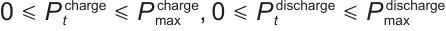

式中,Ptcharge、Ptdischarge分别满足充电和放电功率:

|

(5) |

进一步地,系统调度需要遵循功率约束,可以表示为式(6):

|

(6) |

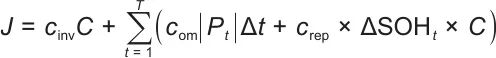

1.3成本建模

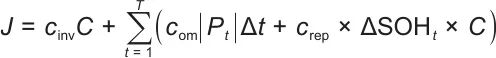

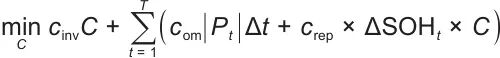

全生命周期成本包括初始投资成本、运营和维护成本以及因退化而产生的更换成本。将电池容量设置为C,单位容量的投资成本设置为cinv,单位能量的维护成本设置为com,根据SOH退化曲线动态调整电池更换成本,总体成本函数可以表示如式(7):

|

(7) |

式中,crep为每单位容量退化的重置成本;∆SOHt为时间t的容量损失;T为优化周期。

2 改进深度强化学习算法

本研究提出了一种用于电网侧储能容量优化的改进深度强化学习算法(enhanced deep reinforcement learning,E-DRL),旨在解决传统优化方法中忽视动态电池退化过程的问题。该方法通过构建电池的高保真仿真模型并将其嵌入优化框架中,准确模拟电池的电化学特性和健康退化过程,从而建立考虑全寿命成本的容量和运行联合优化模型。

2.1深度强化学习算法

DRL是融合深度学习与强化学习的智能决策技术,通过智能体与环境的持续交互优化策略,以最大化长期累积回报。其核心框架由状态(state)、动作(action)、奖励(reward)、转移函数和策略构成:在时间步t,智能体观测状态st按策略π(at|st)选择动作at,执行后环境转移至st+1并返回奖励rt+1,目标是通过优化策略最大化累积折扣奖励。深度学习通过神经网络表示值函数或策略函数,解决高维空间下的决策难题,而强化学习的“试错”机制使其适用于电网侧储能调度等动态不确定场景——通过合理设计状态空间(如电网运行参数)、动作空间(如储能功率控制)与奖励函数(如经济-寿命多目标平衡),可实现储能系统的智能优化调度。

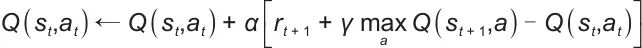

DRL通常使用具有迭代更新公式的Q学习算法来更新动作值函数Q(s,a):

|

(8) |

式中,α为学习率;γ为折扣系数; Q(st+1,a)为下一状态的最大期望值。

Q(st+1,a)为下一状态的最大期望值。

在深度Q网络(DQN)中,动作值函数由深度神经网络近似。DQN引入了经验回放和固定Q目标的机制来稳定训练过程。经验回放通过将样本存储为(s, a, r, s′)并用随机采样更新参数来避免样本相关性,固定Q目标通过引入目标网络来生成Q值从而减少训练振荡。

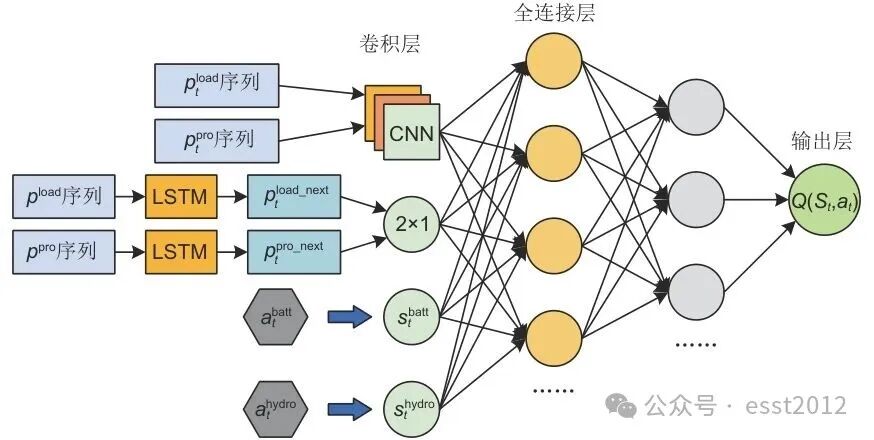

2.2深度强化学习算法的设计

在E-DRL框架中,首先构建了一个高保真电池仿真模型,涵盖了电压、电流、SOC、SOH等关键变量及其退化机制。通过将物理模型与数据驱动模型融合,形成状态空间S和动作空间A之间的映射关系,确保了仿真环境中状态传输的准确性和一致性。通过与仿真环境的持续交互,智能体对状态st ∈S采样,选择动作at ∈ A,并根据当前状态和动作,仿真模型输出即时奖励rt+1和下一个状态st+1,反映了容量分配和运营策略对经济性和电池健康的综合影响。

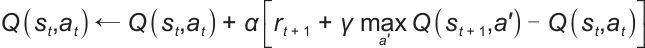

DRL利用仿真环境提供的高质量数据构建价值函数Q(s, a),该函数用于表示在状态s中采取行动a可以获得的预期累积奖励。考虑到长期优化的需要,引入了折扣系数γ∈(0,1)来调节未来奖励的权重。学习过程通过最小化时间差误差(TD误差)来连续迭代地更新策略。具体来说,值函数的迭代公式为:

|

(9) |

式中,α为用于控制更新步长的学习率;rt+1为当前动作产生的即时奖励; Q(st+1,a′)为未来状态下最佳动作的期望值。

Q(st+1,a′)为未来状态下最佳动作的期望值。

仿真环境的引入显著提高了Q函数估计的准确性,特别是在非线性和渐进复杂的状态演化过程中,如电池老化。与依赖于简化或静态模型的传统DRL方法相比,E-DRL通过闭环仿真提供的准确状态转换和奖惩反馈,确保政策学习过程能够平衡短期经济效益和长期健康维护,从而实现系统在整个生命周期内的最优配置。

2.3产能和运营的联合优化和整合策略

容量分配和运行策略的协同优化是E-DRL算法的核心任务。通过对仿真模型的高精度仿真,E-DRL算法能够实时捕捉电池的动态特性,找到容量分配和运行策略之间的最佳平衡。具体来说,容量配置的优化目标是:

|

(10) |

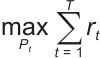

式中,C为电池容量;T为计划持续时间。则运营策略的优化目标为:

|

(11) |

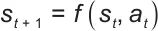

动态平衡机制是E-DRL算法在短期经济效益和长期电池寿命之间实现最佳平衡的关键。在仿真环境中,智能体通过连续交互学习最优策略,其状态传递方程为:

|

(12) |

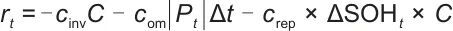

式中,f为状态传递函数。奖励功能的设计考虑了电池健康状态恶化对系统成本的影响,其形式为:

|

(13) |

整个生命周期成本的优化是E-DRL算法的最终目标。通过仿真模型的高精度仿真和强化学习的智能决策,E-DRL算法可以有效降低系统成本。全生命周期成本函数为:

|

(14) |

图1给出了基于改进深度强化学习(E-DRL)的电网侧储能策略建模流程。该流程以数据驱动与模型驱动相结合的方式,实现储能系统全生命周期的智能化管理。首先,通过部署于储能设备的多类型传感器(如电压、电流、温度传感器)实时采集电池运行数据,包括充放电电流、电压曲线、内部温度、荷电状态(SOC)及健康状态(SOH)等关键参数。采集的数据经降噪滤波、归一化等预处理后筛选出与电池性能强相关的核心特征。这些数据与特征作为基础输入,结合电化学模型构建高保真度的电池仿真模型,该模型能够精准模拟电池在不同工况下的电化学动态特性,以及长期循环过程中的容量衰减、内阻增长等健康退化规律。

图1 改进深度强化学习的储能策略建模流程

随后,基于仿真模型构建状态空间涵盖电网实时负荷、可再生能源出力预测值、储能系统剩余容量(SOC)、电池健康状态(SOH)、实时电价等多维信息,全面表征系统运行状态。动作空间定义为储能系统的充放电功率调节指令,包括功率大小与充放电状态切换。奖励函数的设计则融合短期与长期目标:短期目标聚焦于峰谷电价套利收益、可再生能源消纳量等经济效益指标,长期目标则纳入电池退化成本(基于循环寿命损耗模型计算)、维护成本等全生命周期要素,通过加权求和实现多目标平衡,为深度强化学习提供明确优化导向。

在E-DRL算法运行阶段,智能体与仿真环境进行高频次交互训练。每一次交互中,智能体依据当前状态,通过策略网络输出动作指令,仿真模型根据动作执行结果反馈新状态与奖励值。算法利用经验回放机制存储交互数据,通过批量学习优化策略网络参数,逐步学习在复杂电网场景下的最优储能容量分配与运行策略,实现短期收益与电池寿命的动态平衡。最终,训练完成的E-DRL模型输出优化后的储能容量配置方案及实时运行策略。通过蒙特卡洛模拟、历史场景复现等方式进行性能评估,从经济性(全生命周期成本、投资回报率)、可靠性(电网峰谷调节能力、可再生能源消纳率)、电池健康度(寿命延长比例、退化速率减缓程度)等多维度验证策略有效性。

3 案例分析

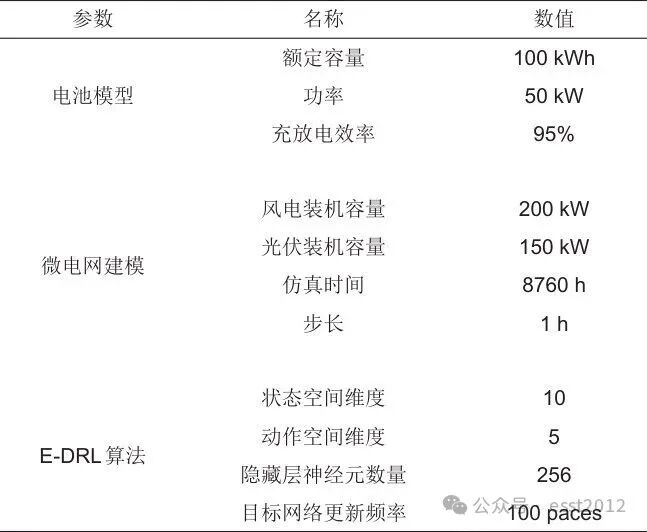

本研究采用MATLAB/Simulink平台构建仿真测试环境,针对园区级微电网场景,对基于仿真驱动深度强化学习(E-DRL)的电网侧储能系统容量优化策略进行有效性验证。该算例对象区别于传统大电网调度场景,聚焦于包含多元负荷与分布式能源的封闭电力系统——园区级微电网具有负荷类型集中(含工业生产负荷、商业建筑负荷及公共设施负荷)、能源供给多元(涵盖分布式光伏、小型风电及市电补充)、运行边界明确等特征,其储能容量优化需同时兼顾本地能源消纳、峰谷电价套利及供电可靠性保障,与大电网调度中侧重系统稳定裕度、输电损耗控制的优化目标存在显著差异。

仿真模型针对园区级微电网特性,构建四大核心模块协同模拟复杂运行场景。

①高精度电池仿真模型:基于磷酸铁锂电池电化学机理,融合等效电路模型与衰减特性方程,精确刻画电池在不同充放电倍率、温度环境下的SOC变化规律、容量衰减速率及充放电效率曲线。通过嵌入实时老化因子校正模块,实现对电池全生命周期性能衰减的动态模拟,为储能容量优化提供精准的物理约束基础。

②深度强化学习智能体模块:采用改进型TD3(twin delayed deep deterministic policy gradient)算法架构,输入层接收多维度状态信息,隐藏层通过注意力机制强化关键特征权重,输出层生成连续充放电功率指令。智能体训练过程中引入微电网专属奖励函数,综合考量峰谷负荷差削减量、新能源弃电率、储能运维成本及电池循环寿命损耗等核心指标。

③动态微电网负荷模型:基于园区实际负荷统计数据,构建时序负荷生成器。其中工业负荷呈现周期性冲击特性(如生产线启停),商业负荷具有日间高峰特征,公共设施负荷保持基础稳定输出,通过蒙特卡洛抽样模拟三类负荷的随机波动分量,生成具有典型日特征的动态负荷曲线,负荷峰谷差设定为日均负荷的45%~60%。

④可再生能源发电模型:整合分布式光伏与小型风电仿真单元,光伏模块基于本地气象数据生成小时级辐照度曲线,考虑云层遮挡导致的短期波动;风电模块引入Weibull分布模拟风速随机性,输出功率曲线需满足切入风速(3 m/s)与切出风速(15 m/s)约束。两类电源总装机容量与园区最大负荷的比例设定为0.8~1.2,模拟高比例新能源接入场景。

各子模型通过Simulink的模块化接口实现实时数据交互:电池仿真模型实时上传SOC、端电压、内部温度及健康状态(SOH)等核心参数,为DRL智能体提供系统状态观测;智能体依据状态信息输出最优充放电功率指令,驱动电池仿真模型执行充放电行为,同时接收模型反馈的功率执行偏差与状态更新结果;动态微电网负荷模型每15 min更新1次负荷需求曲线,可再生能源发电模型同步输出预测功率与实际功率偏差,二者共同构建含不确定性的供需环境——通过设置±10%的光伏功率预测误差、±8%的负荷预测误差,模拟新能源出力与负荷需求的动态波动特性。

通过多场景仿真测试,量化分析E-DRL策略在不同运行条件下的储能容量配置方案、经济性指标(投资回报周期、度电成本)及技术指标(新能源消纳率、供电可靠性),为园区级微电网侧储能系统的规划设计提供数据驱动的决策依据。仿真参数见表1。

表1 仿真模型的主要参数设置

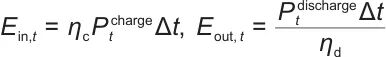

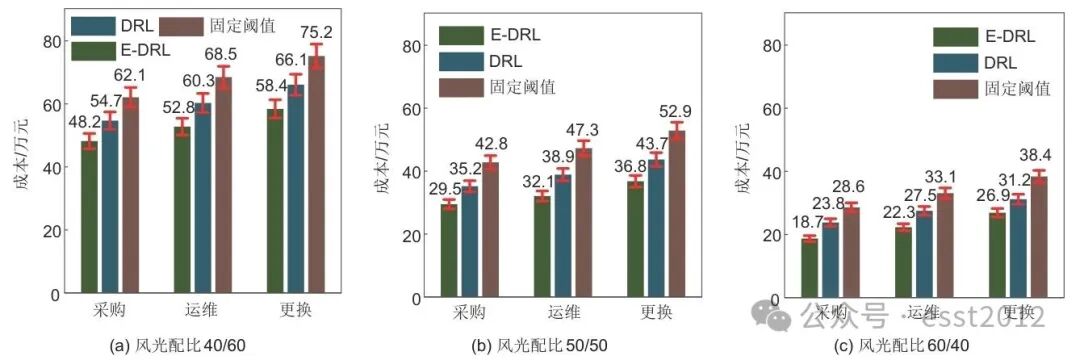

图2给出了在不同风电占比场景下,基于改进深度强化学习方法(E-DRL)、传统深度强化学习方法(DRL)及基准方法的全生命周期成本构成对比分析。不同场景下的LCC分析结果表明,所提E-DRL算法在经济性能方面表现出显著优势。从3种场景(风光配比40/60、50/50及60/40)的对比结果可见,E-DRL方法在采购成本、运维成本及更换成本三个维度均实现了最优成本控制。具体而言,在40/60风光配比场景中,E-DRL方法的采购成本为48.2万元,较传统DRL方法(54.7万元)降低11.9%,较基准方法(62.1万元)降低22.4%;50/50风光配比优化结果为29.5万元,分别较传统DRL和基准方法降低16.2%和31.1%;60/40风光配比优化效果更为显著,E-DRL方法实现了18.7万元的成本控制,较传统DRL和基准方法分别降低21.4%和34.6%。

图2 全生命周期成本构成的比较分析

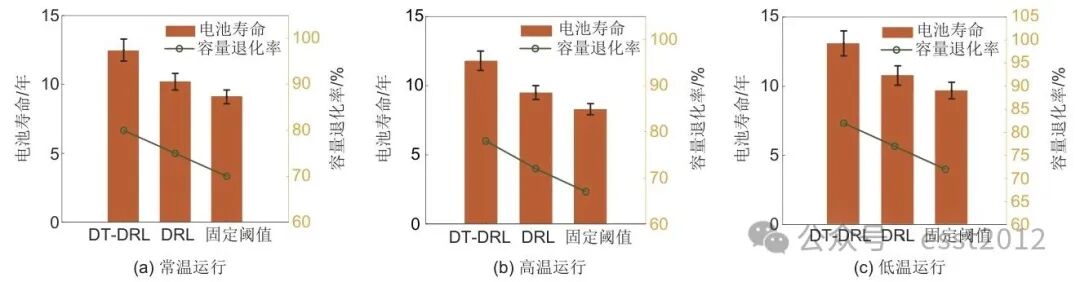

图3给出了不同优化策略对电池寿命及容量衰减率的影响,通过解析策略执行过程中的核心优化动作与电池退化机制的关联,可更深入揭示E-DRL策略的优势所在。结果表明,本研究提出的E-DRL策略通过精细化的动态调控机制,在延长电池寿命和维持容量方面展现出显著优势,其优化过程与传统方法存在本质差异。传统DRL策略采用固定充放电倍率上限(如1 C),在高负荷需求时易出现短时2 C以上大电流充放电。而E-DRL策略通过仿真模拟不同倍率下的锂枝晶生长速率,当检测到电芯内部压力超过0.3 MPa(通过等效电路模型反演)时,自动将充放电倍率限制在0.8 C以内;在SOC处于20%~80%的健康区间时,允许1.2 C峰值功率输出,实现“按需调控”。数据显示,该机制使大电流充放电时长占比从传统DRL的18%降至7%,显著减少了电极材料的机械应力损伤。

图3 不同优化策略下的电池寿命比较

E-DRL策略将温度控制纳入优化目标,通过仿真预测不同环境温度下的散热需求:当电芯温度超过35℃时,提前触发散热系统(风扇转速从1500 r/min提升至2500 r/min),并降低充放电功率以减少产热;在低温环境(<5℃)下,通过预热控制将电芯温度维持在15~25℃,避免低温充电导致的锂沉积。对比实验表明,E-DRL策略下电池工作温度波动范围控制在±3℃以内,而传统DRL和固定阈值策略的温度波动分别达±5℃和±7℃,温度稳定性的提升使电解液分解速率降低约20%。

固定阈值策略采用简单的50%~80%充放电区间,传统DRL虽有优化但仍存在频繁逼近极限SOC的现象(SOC<20%或>90%的时长占比达12%)。E-DRL策略基于仿真的容量衰减模型,动态调整SOC运行区间:在电池寿命初期(SOH>90%)允许SOC在15%~90%波动,随着老化加深(SOH<80%)自动收缩至25%~85%,并减少SOC跨越50%的次数(每月降低25次循环)。这种动态区间管理使电池深度充放电循环次数较传统方法减少32%,有效减缓了正极材料的结构相变。

基于上述优化动作,E-DRL策略的最终效果表现为:E-DRL策略下的电池平均寿命达12.50年,较传统DRL策略(10.20年)和固定阈值策略(9.10年)分别提高2.30年和3.40年,相当于提升22.55%和37.36%。从寿命分布来看,E-DRL策略下所有样本寿命均超过11年,而传统DRL策略有15%的样本寿命低于9年,固定阈值策略这一比例高达30%。误差棒分析显示,E-DRL策略在-10~45℃的温度运行条件下表现出更高的稳定性,寿命波动范围为±0.80年。需特别说明的是,虽然传统DRL(±0.60年)和固定阈值策略(±0.50年)的波动范围更小,但这是由于其寿命整体偏短、退化机制单一导致的,而E-DRL在更宽的有效寿命区间内仍能保持稳定表现。

在10年使用周期内,E-DRL策略通过上述动态调控,使电池容量衰减速率保持线性下降趋势,年均衰减率控制在2%以内;相同周期后,E-DRL策略下的电池容量仍维持在80%左右(额定容量的79.6%),而传统DRL策略因频繁大电流充放电导致容量降至75.2%,固定阈值策略因温度控制不足和深度循环问题使容量仅存69.8%。尤其在第5~8年的加速衰减阶段,E-DRL策略的容量保持率比传统方法高出5%~8%,体现了精细化管理对延缓老化的关键作用。

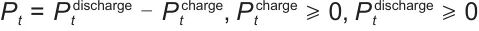

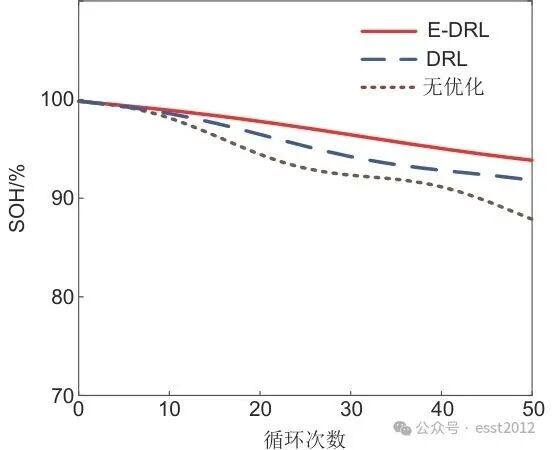

图4给出了E-DRL、传统DRL及无优化策略下锂离子电池健康状态(SOH)的退化趋势。对比分析表明,E-DRL优化策略表现出最优异的电池保护性能:其SOH衰减曲线呈平缓的指数型退化,在50次充放电循环后仍维持约94.0%的健康状态。这一优异性能主要归因于E-DRL算法通过仿真模型对电池内部状态的精准预测与动态监测,能够实时调整充放电策略,避免深度充放电、过充过放等有害操作,有效减缓电池容量衰减与内阻增长。尽管传统DRL优化策略相较无优化方案有一定改善,但其在相同循环次数下SOH降至约91.2%,比E-DRL方法低约2.8%。这一差距主要源于传统DRL方法缺乏对电池内部物理过程的深度认知,仅基于历史运行数据学习策略,难以实现电池状态的精准预测与主动保护。无优化策略的SOH退化轨迹呈现典型的快速非线性衰减特征,50次循环后健康状态降至约87.5%,其显著性能劣化主要归因于缺乏智能充放电管理,导致频繁深度放电与不当充电策略。综合对比分析表明,E-DRL方法通过构建高保真电池仿真模型并结合深度强化学习的动态优化能力,在储能系统健康管理方面实现了突破性技术进展,为提升微电网侧储能系统的经济性与可靠性提供了重要技术支撑。

图4 电池健康状态的退化轨迹分析

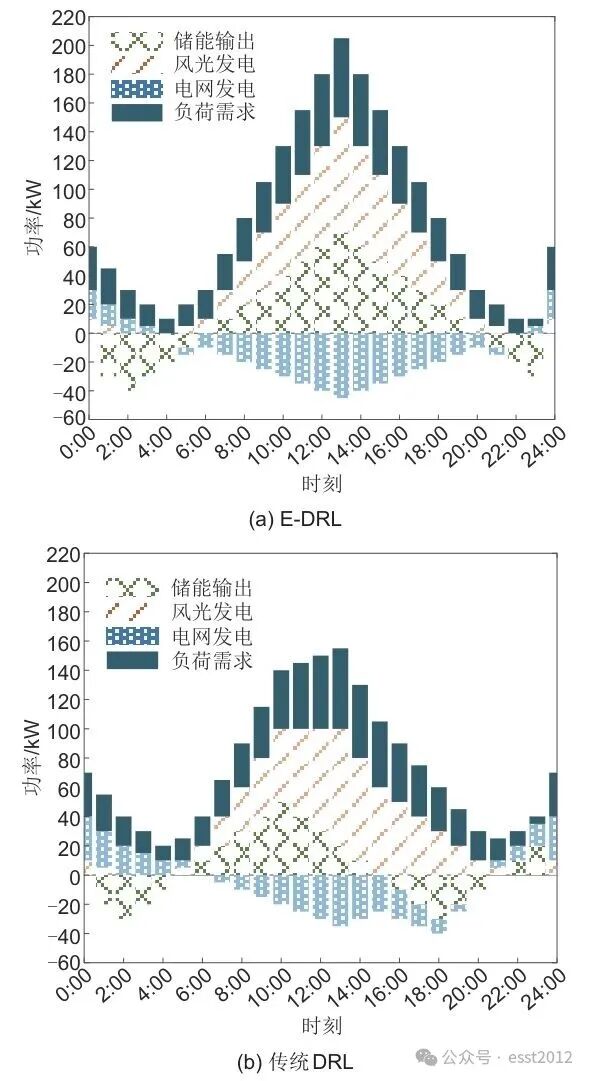

图5给出了典型日的能源调度效果对比,呈现了储能出力、风光发电、电网交互功率及负荷需求在24 h内的动态变化。在优化超参数配置下(折扣因子γ =0.95,经验回放池大小为106),E-DRL算法的调度表现具体如下。在高负荷时段(10:00—12:00及18:00—20:00),储能系统根据风光发电波动动态调整放电功率,与风电、光伏出力形成互补。当午间光伏出力达峰值45 kW时,储能放电功率降至10 kW;而在傍晚光伏出力骤减阶段,储能以30 kW功率持续放电,二者协同满足最高达55 kW的用电需求,使该时段大电网购电功率从传统策略的40 kW降至15 kW,有效降低对大电网的依赖。在低负荷夜间时段(0:00—6:00),储能系统以最大40 kW功率充电,充分吸纳电网低谷电力与夜间风电余电(约15 kW),使储能SOC从30%提升至90%,为次日调峰储备能量。相比传统DRL策略,低谷时段充电量增加25%,提升了能源利用效率。该调度策略将电网峰谷差从最大值55 kW(18:00负荷峰值与4:00负荷谷值之差)显著缩小至35 kW,降幅达36.36%;同时,电网交互功率波动范围从原-45 kW(负号表示向电网售电)至20 kW收窄至-30~15 kW,波动幅度(最大值与最小值之差)从65 kW降至45 kW,降低41.54%,大幅减轻了对电网的冲击。

图5 典型场景下的能源调度效果比较

作为深度强化学习算法的核心配置,折扣因子(γ)、经验回放池大小及学习率(α)的取值对调度策略性能具有关键影响,通过控制变量法测试得到如下规律:折扣因子决定了智能体对未来奖励的重视程度。实验发现,当γ=0.90时,智能体更关注短期收益,表现为高负荷时段过度放电(单次最大放电功率达50 kW),虽能临时降低电网购电,但导致后期储能SOC不足,低谷时段充电功率被迫提升至45 kW,反而使电网低谷负荷增加10%;当γ =0.98时,智能体过度关注长期收益,出现“保守充电”现象,午间光伏弃电率达18%(优化值为8%),储能利用率降低20%。而γ =0.95时实现最佳平衡,既能保证当前负荷需求满足,又能为后续时段储备足够能量,此时可再生能源利用率达92%,较γ =0.90和γ =0.98分别提升10%和8%。

经验回放池用于存储智能体与环境交互的样本(状态-动作-奖励-下一状态),其大小影响训练稳定性。当池大小为105时,样本多样性不足,算法易陷入局部最优,表现为调度策略在相似负荷模式下重复相同动作(如每日18:00固定放电30 kW),无法适应风光出力波动,导致单日峰谷差波动范围达±8 kW;当池大小为5×106时,虽样本丰富,但训练时随机采样效率降低,收敛速度变慢(训练步数增加60%),且易引入噪声样本,电网交互功率波动幅度较优化值升高15%。实验表明,池大小为106时性能最优,既能保证样本多样性覆盖不同工况,又能维持训练效率,使算法在5000步内稳定收敛。

学习率控制神经网络参数更新幅度:α=0.0001时,参数更新缓慢,算法需8000步才能收敛,且前期调度策略不稳定(峰谷差降幅仅20%);α=0.001时,更新幅度过大导致训练振荡,约30%的训练周期出现策略退化(储能充放电逻辑混乱);而α=0.0005时,收敛速度与稳定性达到平衡,算法在4000步内收敛,最终峰谷差降幅稳定在36%左右,与优化值偏差不超过2%。

综上,E-DRL算法通过优化超参数配置(γ=0.95、经验回放池大小为106、α=0.0005),实现了典型日能源调度的高效性与稳定性。这些超参数的合理取值确保了智能体既能充分利用历史经验学习全局最优策略,又能快速适应实时工况变化,最终在提升可再生能源利用率、缩小电网峰谷差、降低功率波动等方面展现出优异性能,为电网侧储能系统的优化调度提供了可靠的算法支撑。

4 结论

本研究提出了一种用于电网侧储能的E-DRL容量优化方法,该方法通过构建嵌入优化框架的高保真度电池仿真模型,准确模拟电池的电化学特性和健康退化过程,并建立考虑全生命周期成本的容量和运行联合优化模型。仿真结果表明,与传统的DRL和基准方法相比,E-DRL算法在经济性能与调度效果上均表现优异。在成本控制方面,E-DRL算法显著降低了系统在不同风光比场景下的全生命周期成本。同时,该算法能有效延长储能系统的使用寿命,E-DRL策略下的电池平均寿命较传统DRL策略和固定阈值策略分别提高22.55%和37.36%。在电网调度关键指标上,E-DRL方法展现出更强的系统协同优化能力。在新能源消纳方面,得益于仿真模型对风光出力波动的精准刻画和DRL智能体的动态决策,E-DRL策略下的风电消纳率达到92.3%,较传统DRL方法提高8.7%,大幅减少了弃风弃光现象,保障了电网的稳定运行。

通讯作者:杨瑞锋(1986—),男,硕士,工程师,研究方向为继电保护及其自动化、配网自动化。

第一作者:杨瑞锋(1986—),男,硕士,工程师,研究方向为继电保护及其自动化、配网自动化。

免责声明:本站所有信息均来源于互联网搜集,并不代表本站观点,本站不对其真实合法性负责。如有信息侵犯了您的权益,请告知,本站将立刻删除。